生成AIマーケティングで失敗しない!具体的なトラブル事例と万全な対策

生成AIは、現代のマーケティング活動に革命をもたらす強力なツールとして、多くの企業で導入が進んでいます。

コンテンツ作成の効率化や、これまでにないクリエイティブの創出など、その可能性は無限大です。しかし、その一方で、生成AIの利用には著作権侵害、情報漏洩、ブランドイメージの毀損といった深刻なトラブルが潜んでいることも事実です。

便利なツールだからと安易に飛びついてしまい、思わぬ落とし穴にはまってしまうケースも少なくありません。

この記事では、生成AIをマーケティングに活用する際に実際に起こりうる具体的なトラブル事例を徹底的に解説し、それらを未然に防ぐための今日から実践できる対策を網羅的にご紹介します。

最後までお読みいただくことで、生成AIのリスクを正確に理解し、安全かつ効果的にマーケティング成果を最大化するための具体的な知識と手順を得ることができます。

生成AIマーケティングの光と影、そのトラブル事例

生成AIがマーケティングの世界に登場し、多くの可能性を切り拓いています。

これまで時間とコストを要していた広告コピーの大量生成、顧客セグメントに合わせたパーソナライズドDMの作成、魅力的なSNS投稿画像の自動生成など、その恩恵は計り知れません。

これにより、マーケティング担当者はより戦略的な業務に集中できるようになり、ROI(投資対効果)の向上も期待されています。

しかし、この革新的な技術には見過ごすことのできない「影」の部分が存在します。それは、予期せぬ形で発生する様々なトラブル事例です。

例えば、生成されたコンテンツが意図せず特定の層を不快にさせる表現を含んでしまい、SNSで炎上するケース。

あるいは、学習データに由来する著作権問題をクリアできず、他社の権利を侵害してしまう事例。

さらには、社内の機密情報をプロンプトとして入力してしまった結果、重大な情報漏洩につながるリスクも指摘されています。

これらのトラブルは、一度発生すると企業のブランドイメージを大きく損ない、顧客からの信頼を失うだけでなく、法的な紛争に発展する可能性さえあります。

生成AIという強力なツールを使いこなし、その恩恵を最大限に享受するためには、光の部分だけを見るのではなく、影の部分、すなわち潜在的なリスクとトラブル事例を深く理解し、万全の対策を講じることが不可欠なのです。

本記事では、この光と影の両側面を具体的に掘り下げていきます。

なぜ起こる?生成AIマーケティングのトラブル事例

生成AIマーケティングにおけるトラブルは、決して偶然に発生するわけではありません。

その背景には、技術的な特性や人間の使い方に起因する、いくつかの明確な原因が存在します。これらの根本原因を理解することが、効果的な対策を立てるための第一歩となります。

生成AIの技術的な限界とブラックボックス問題

一つ目の原因は、生成AIそのものが持つ技術的な限界です。

現在の生成AIは、膨大なデータを学習し、そのデータに含まれるパターンや関連性に基づいて新しいコンテンツを生成します。しかし、AIはデータの内容を人間のように「理解」しているわけではありません。

そのため、学習データに偏りや誤りが含まれていると、それがそのまま生成物に反映されてしまいます。これが、差別的な表現や不正確な情報(ハルシネーション)を生み出す一因です。

また、なぜAIがそのアウトプットを出したのか、その思考プロセスが人間には完全には分からない「ブラックボックス」である点も、トラブルの原因を特定しにくくしています。

人間の知識不足と安易な利用が招くトラブル

二つ目の原因は、利用者側の問題です。

生成AIの便利さだけが先行し、その裏に潜むリスク、特に法律や倫理に関する知識が不足したまま利用してしまうケースが後を絶ちません。

例えば、著作権に関する理解が曖昧なまま、生成された画像を商業利用してしまったり、ファクトチェックの重要性を認識せずにAIが生成した文章をそのままブログ記事として公開してしまったりすることです。

ツールの操作は簡単でも、その生成物を社会に公開する責任は利用者にあります。この「責任の所在」に対する意識の低さが、多くのトラブル事例の引き金となっているのです。

ガイドラインや運用ルールの不備という組織的問題

三つ目の原因は、組織としての体制不備です。

多くの企業では、生成AIの導入が現場レベルで先行し、会社全体としての明確な利用ガイドラインや運用ルールが整備されていないのが現状です。

誰が、どのツールを、どのような目的で、どこまで使って良いのか。

生成物のチェック体制はどうするのか。万が一トラブルが発生した場合、誰が責任を取るのか。

これらのルールが曖昧なままでは、担当者個人の判断に委ねられる部分が大きくなり、組織全体としてリスクをコントロールすることができません。

結果として、防げたはずのトラブルが発生してしまうのです。

【著作権侵害】生成AIマーケティングのトラブル事例

生成AIマーケティングにおいて、最も頻繁に議論され、かつ企業にとって致命的なダメージとなりかねないのが「著作権侵害」に関するトラブルです。

AIが生成したコンテンツが、気づかぬうちに第三者の権利を侵害してしまうリスクは、常に念頭に置かなければなりません。

学習データ由来の著作権トラブル

生成AIは、インターネット上にある膨大な画像、文章、音楽などを学習データとしています。

この中には、当然ながら著作権で保護された作品が大量に含まれています。AIがこれらのデータを学習し、特定のアーティストの画風に酷似したイラストや、既存の小説の一節とそっくりな文章を生成してしまうことがあります。

これをマーケティング活動で無断使用した場合、元の作品の著作権者から権利侵害を主張され、損害賠償請求や使用差し止めといった法的な措置を取られる可能性があります。

特に、特定の作家名や作品名をプロンプトに含めて生成する行為は、意図的に模倣していると見なされ、リスクが非常に高まります。

商標や肖像権を侵害するトラブル事例

著作権だけでなく、商標権や肖像権の侵害も重大なトラブル事例です。

例えば、生成AIに「有名ブランドA社のロゴが入った未来的な車」というプロンプトで画像を生成させ、それを広告に使用したとします。この場合、A社の商標権を侵害する可能性が極めて高いです。

同様に、実在する特定の俳優や有名人の顔写真を無断で学習させ、広告キャラクターとして生成・使用する行為は、肖像権(パブリシティ権)の侵害にあたります。

これらの権利侵害は、企業のコンプライアンス意識の欠如を露呈し、ブランドイメージに深刻な打撃を与えることになります。

【炎上リスク】生成AIマーケティングのトラブル事例

SNSが普及した現代において、企業のマーケティング活動は常に「炎上」のリスクと隣り合わせです。

生成AIの利用は、この炎上リスクを予期せぬ形で増幅させてしまう可能性があります。一度炎上してしまうと、情報の拡散は瞬く間に進み、鎮静化には多大な労力とコストがかかります。

不適切・差別的なコンテンツ生成による炎上

生成AIの学習データには、インターネット上に存在するポジティブな情報だけでなく、ネガティブで偏った情報、差別的な表現なども含まれています。

AIはこれらの文脈を完全に理解できないため、意図せず不適切なコンテンツを生成してしまうことがあります。

例えば、ある特定の属性を持つ人々をステレオタイプ的に描写した画像を広告に使用してしまったり、歴史的にデリケートな問題を軽視するような文章を生成してしまったりするケースです。

これらのコンテンツは、多くの人々を不快にさせ、SNS上で批判が殺到し、大規模な不買運動や企業への抗議に発展する可能性があります。

文脈を無視した不謹慎なコンテンツによる炎上

生成AIは、社会的な常識やその時々の世間の空気を読むことができません。

そのため、大規模な災害や悲しい事件が起きている最中に、そうした状況を全く考慮しない、あまりにも楽観的で場違いなマーケティングメッセージを生成・投稿してしまうリスクがあります。

人間の担当者であれば当然配慮するようなことでも、自動化されたシステムでは見逃されてしまうのです。

このような「不謹慎」と受け取られるコンテンツは、企業の倫理観を疑わせる原因となり、激しい非難を浴びて炎上する典型的なトラブル事例と言えます。

【情報漏洩】生成AIマーケティングのトラブル事例

生成AIの利便性を追求するあまり、企業の情報セキュリティを脅かす「情報漏洩」のリスクを見過ごしてはいけません。

特に、対話型の生成AIサービスを利用する際には、入力する情報(プロンプト)の取り扱いに細心の注意が必要です。

プロンプト入力による機密情報の漏洩リスク

マーケティング戦略を立案する際、より精度の高いアウトプットを求めて、未発表の新製品情報、詳細な顧客データ、社外秘の販売戦略などをプロンプトとして入力してしまうケースが考えられます。

しかし、多くの外部AIサービスでは、入力されたデータがAIの再学習に利用される規約になっていることがあります。これはつまり、入力した機密情報がサービス提供者に渡り、将来的に他のユーザーへの回答として出力されてしまう可能性がゼロではないということです。

このメカニズムを理解せずに機密情報を入力する行為は、意図せずして重大な情報漏洩を引き起こす、極めて危険なトラブル事例です。

AIサービスからのアカウント情報流出

もう一つの情報漏洩リスクは、利用している生成AIサービスそのものがサイバー攻撃を受け、登録しているアカウント情報や過去の利用履歴(プロンプトや生成物の履歴)が外部に流出してしまうケースです。

もし、過去のプロンプトに個人情報や企業の機密情報が含まれていた場合、その被害は甚大なものになります。

利用するサービスのセキュリティレベルや信頼性を十分に吟味せずに安易に登録・利用することは、自社の情報を危険に晒すことと同義です。

特に、マーケティング部門がIT部門の許可なく独自にサービスを導入する「シャドーIT」は、こうしたリスクを増大させる要因となります。

事例から学ぶ生成AIマーケティングの基本対策とは

これまで見てきたような深刻なトラブル事例を回避するためには、具体的かつ実践的な対策を組織全体で講じる必要があります。

場当たり的な対応ではなく、体系的なリスク管理体制を構築することが、安全なAI活用の鍵となります。

社内利用ガイドラインの策定と周知徹底

まず最初に行うべきは、自社における「生成AI利用ガイドライン」の策定です。このガイドラインには、以下のような項目を明記する必要があります。

- 利用目的の明確化: マーケティング活動において、どのような目的で生成AIを利用するのかを定義します。

- 利用可能なツールの指定: セキュリティや著作権のリスクを評価し、会社として利用を許可するAIツールをリストアップします。

- 入力禁止情報の定義: 個人情報、顧客データ、未公開の経営情報など、プロンプトとして入力してはならない情報を具体的に定めます。

- 生成物の権利確認と帰属: 生成されたコンテンツの著作権が誰に帰属するのか、商用利用が可能かを確認する手順を定めます。

- 免責事項と責任の所在: AIの生成物には誤りが含まれる可能性があることを明記し、最終的な確認責任は人間にあることを明確にします。

このガイドラインを策定するだけでなく、全従業員を対象とした研修会などを実施し、その内容を周知徹底させることが極めて重要です。

生成AIトラブルを未然に防ぐ具体的なガイドライン対策

策定したガイドラインを形骸化させず、実務レベルで機能させるためには、さらに具体的な対策を講じる必要があります。トラブルを「未然に防ぐ」ための仕組みづくりが、マーケティング活動の安全性を担保します。

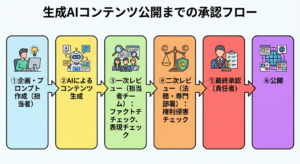

複数人によるチェック体制の構築

生成AIによるアウトプットは、必ず複数の人間の目でチェックする体制を構築すべきです。このチェック体制は、単なる誤字脱字の確認に留まりません。

- ファクトチェック: 生成された情報に事実誤認や不正確な点がないかを確認します。

- 倫理・表現チェック: 差別的、攻撃的、不謹慎な表現が含まれていないか、多角的な視点で検証します。

- 権利侵害チェック: 生成された画像や文章が、既存の著作物や商標と酷似していないか、ツールも活用しながら確認します。 クリエイター、法務担当者、マーケティング担当者など、異なる専門性を持つメンバーがレビューに参加することが理想的です。

マーケティング担当者が知るべき生成AI活用の対策

ガイドラインやチェック体制といった組織的な対策に加え、現場のマーケティング担当者一人ひとりが日々の業務で実践すべき対策もあります。個々のリテラシー向上こそが、トラブルを回避する最も効果的な防御策です。

プロンプトエンジニアリング技術の習得

生成AIを使いこなす上で、「プロンプトエンジニアリング」のスキルは不可欠です。これは、AIから意図した通りの、そして安全なアウトプットを引き出すための指示(プロンプト)を作成する技術です。

例えば、「〇〇のような画像」といった曖昧な指示ではなく、「〇〇の要素を取り入れつつ、著作権フリーの素材のみを参考にした、オリジナルのキャラクターを描いてください」のように、制約条件を明確に指示することが重要です。

また、差別的な表現等の「望ましくない表現」を避けるための指示(ネガティブプロンプト)や、出力形式を細かく指定する技術を学ぶことで、生成物の質と安全性を大幅に向上させることができます。

生成AIの特性と限界を正しく理解する

マーケティング担当者は、生成AIを「魔法の杖」ではなく、あくまで「高度なツール」として捉える必要があります。

AIは間違えること(ハルシネーション)、偏った意見を生成すること、文脈を読めないことがあるという限界を常に意識することが大切です。AIからの提案を鵜呑みにせず、常に批判的な視点を持ち、最終的な意思決定は人間が行うという原則を忘れてはいけません。

ツールの得意なことと不得意なことを見極め、人間の創造性や倫理観と組み合わせることで、初めて生成AIを真に価値あるものとして活用できるのです。

安全な生成AIマーケティングを実現するための法的対策

企業のコンプライアンスを遵守し、法的な紛争を避けるためには、法律の専門家と連携した対策が不可欠です。

特に著作権や個人情報保護に関する備えは、万全を期す必要があります。

弁護士など専門家への相談体制の確保

生成AIに関する法整備は、まだ発展途上の段階にあり、国内外で法解釈が分かれるケースも少なくありません。

自社だけで判断するのは非常に困難であり、リスクも伴います。したがって、AIやIT分野に詳しい弁護士と顧問契約を結ぶなど、いつでも法的な助言を求められる体制を整えておくことが強く推奨されます。

特に、生成AIを利用した新しいマーケティングキャンペーンを始める前や、利用規約が複雑なAIツールを導入する際には、事前にリーガルチェックを受けるべきです。

利用するAIツールの利用規約の精査

利用する生成AIツールの選定にあたっては、その利用規約を細部まで精査することが極めて重要です。特に以下の点に注意してください。

- 生成物の著作権の帰属: 生成したコンテンツの著作権はユーザーに帰属するのか、それともAIサービス提供者にも権利が残るのか。

- 商用利用の可否: 生成物を広告や商品パッケージなどの商用目的で利用することが許可されているか。

- 入力データの取り扱い: プロンプトとして入力した情報が、AIの再学習に利用されるかどうか。オプトアウト(再学習を拒否)する選択肢はあるか。

これらの規約内容を法務部門と共に確認し、自社のセキュリティポリシーやコンプライアンス基準に合致するツールのみを選定することが、法的なトラブルを回避する上で不可欠な対策です。

生成AIトラブル対策を講じて成功したマーケティング

適切な対策を講じることは、単にリスクを回避するだけでなく、むしろ生成AIをより大胆かつ効果的に活用し、マーケティングで大きな成功を収めるための土台となります。対策がもたらすのは「守り」だけではなく、「攻め」の基盤なのです。

ある消費財メーカーでは、新商品のSNSキャンペーンで生成AIを活用しました。

同社はまず、厳格な社内ガイドラインを策定。著作権侵害リスクの低い国産AIツールを選定し、プロンプトには個人情報や社外秘情報を含めないことを徹底しました。

生成された画像やキャッチコピーは、マーケティング部門と法務部門の担当者からなるレビューチームが、表現の適切性や権利侵害の有無を二重三重にチェック。この徹底したリスク管理体制があったからこそ、担当者は安心して多様なクリエイティブの生成に挑戦できました。

結果として、従来の手法では考えられなかった斬新なアイデアが次々と生まれ、キャンペーンはSNSで大きな話題となり、商品の売上を前年比150%に伸ばす大成功を収めました。

この事例は、適切なトラブル対策こそが、生成AIマーケティングの成功に不可欠であることを示しています。

未来の生成AIマーケティングと進化するトラブル対策

生成AIの技術は日進月歩で進化しており、それに伴いマーケティングの手法も、そして潜在的なトラブルの形態も変化していくでしょう。未来を見据え、常に対策をアップデートしていく姿勢が求められます。

今後は、個人の購買履歴や行動データを基に、一人ひとりに最適化された広告クリエイティブをAIがリアルタイムで自動生成するような、より高度なパーソナライズドマーケティングが主流になるかもしれません。

そうなれば、個人情報の取り扱いやプライバシー保護の問題は、今以上に重要かつ複雑な課題となります。

また、「ディープフェイク」技術を悪用した偽情報によるネガティブキャンペーンなど、新たな脅威が登場する可能性も否定できません。

こうした未来の変化に対応するためには、技術の最新動向を常にウォッチし、法改正の動きに注意を払うことが不可欠です。社内のガイドラインを定期的に見直し、従業員教育を継続的に実施することで、組織全体のリテラシーを常に高いレベルに保つ必要があります。

生成AIと共存する未来のマーケティングにおいて、進化し続けるリスクに対応できる柔軟な対策と倫理観を持つことこそが、企業が持続的に成長していくための鍵となるでしょう。